A rápida evolução dos modelos de trabalho distribuído e a adoção massiva de infraestruturas cloud-native demandaram uma reestruturação nas arquiteturas de acesso remoto. O paradigma tradicional, baseado na segurança de perímetro, demonstrou ser insuficiente para combater ameaças modernas, levando à consolidação do conceito de Zero Trust (Confiança Zero). Para arquitetos de rede, a construção de um acesso remoto resiliente e seguro exige uma compreensão dos objetivos de negócio, a fim de alinhar as capacidades técnicas dos modelos Secure Access Service Edge (SASE), SD-WAN e Security Service Edge (SSE) com as estratégias de implantação Greenfield e Brownfield.

Identificação de Fluxos de Trabalho Corporativos

A arquitetura Zero Trust permite definir a confiança necessária para que usuários e dispositivos acessem diferentes aplicações, utilizando os princípios de Zero Trust (que demanda uma estratégia bem definida no acesso aos recursos computacionais seja local ou em cloud). Em sua fase de implementação para o acesso remoto as aplicações, é necessário converter esses conceitos em fluxos de trabalho de negócios.

- Colaborador local utilizando um dispositivo confiável para acessar uma aplicação privada no data center local.

- Colaborador local utilizando um dispositivo confiável para acessar uma aplicação privada na nuvem ou SaaS.

- Prestador de serviço local (terceiro) utilizando um dispositivo não confiável para acessar aplicações privadas.

- Visitantes locais com acesso não confiável utilizando apenas a Internet.

- Colaboradores remotos utilizando dispositivos confiáveis para acessar aplicações privadas no data center.

- Colaboradores remotos utilizando dispositivos confiáveis para acessar aplicações em SaaS.

A Relação Causal entre Estratégia de Negócio e Arquitetura de Acesso

A formulação de uma arquitetura de acesso remoto eficaz transcende a mera seleção de produtos; ela deve ser holisticamente guiada pelos pilares de Pessoas, Processos e Tecnologia. O objetivo principal é garantir apenas o acesso necessário (least-privilege access) para um dado serviço.

Do ponto de vista estratégico, a arquitetura deve inicialmente estabelecer um nível dinâmico de confiança para os solicitantes de acesso. Isso requer:

- Definição de Confiança do Usuário: Envolve a autenticação contínua da identidade, que se apoia em técnicas robustas de verificação, como a autenticação multifator (MFA). A estratégia de Zero Trust exige a Verificação Explícita (Explicit Verification), onde nenhuma entidade é automaticamente confiada.

- Definição de Confiança do Dispositivo: Implica assegurar que um dispositivo esteja em um estado saudável (healthy state) e autorizado.

A partir da verificação bem-sucedida, as políticas de acesso são definidas com base no princípio de acesso de privilégio mínimo, frequentemente incorporando conceitos de Just-in-Time (JIT) e Just-Enough Access (JEA), limitando o acesso a recursos críticos apenas quando estritamente necessário.

SASE e SSE: A Convergência de Rede e Segurança

A complexidade crescente da rede, impulsionada pelo uso de multinuvem e trabalho remoto, estimulou o desenvolvimento de modelos unificados.

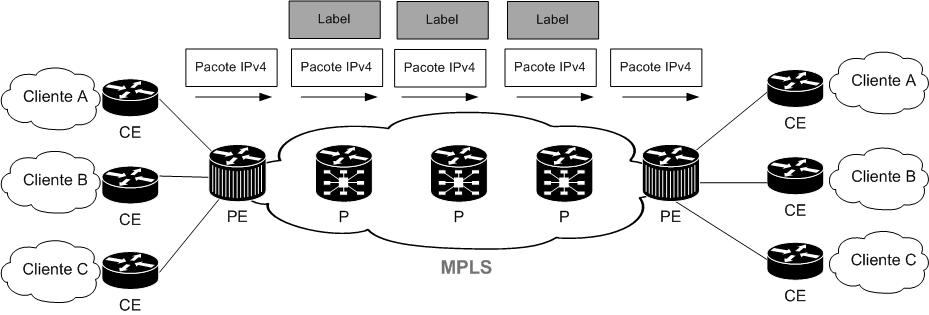

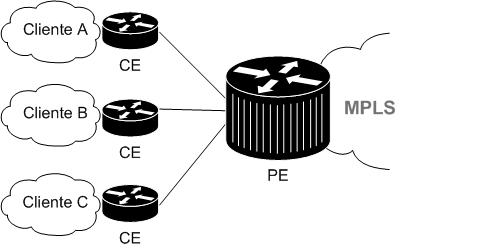

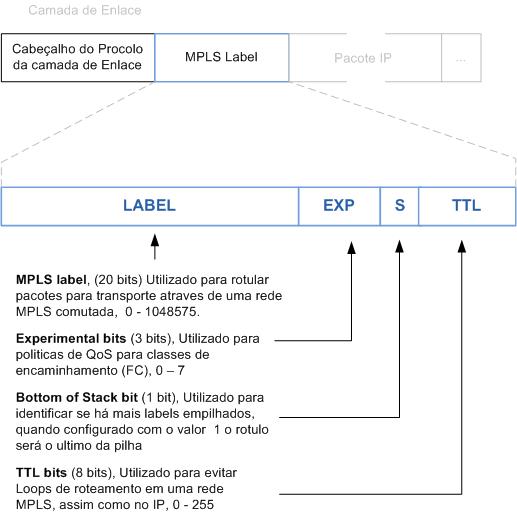

O SASE (Secure Access Service Edge) é uma estrutura de segurança baseada em nuvem que integra serviços de rede, como Software-Defined Wide Area Network (SD-WAN), com serviços de segurança, incluindo firewalls e controle de acesso baseado em identidade e o SSE. O SASE visa simplificar a entrega de serviços de rede e segurança a todos os endpoints, independentemente de sua localização geográfica.

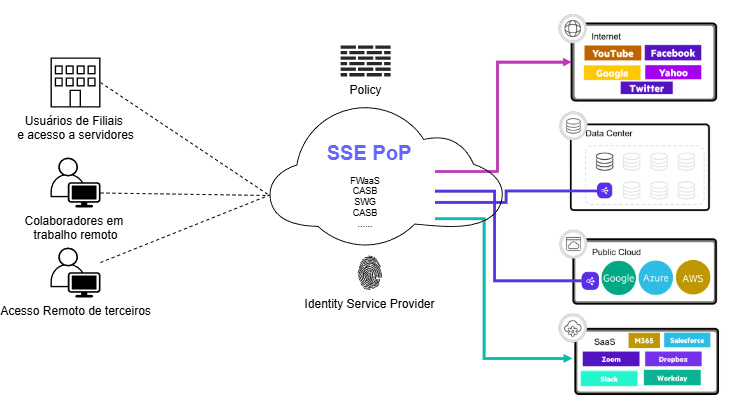

O SSE (Security Service Edge) é um subconjunto fundamental do SASE, focando estritamente nos componentes de segurança, abstraindo a funcionalidade de conectividade da WAN. Os principais componentes do SSE incluem Secure Web Gateway (SWG), Cloud Access Security Broker (CASB) e o acesso remoto, que é tipicamente implementado via Zero Trust Network Access (ZTNA). O SSE tornou-se o método mais adotado pelo mercado para a implementação de arquiteturas Zero Trust devido à sua simplicidade e flexibilidade nativas da nuvem, garantindo a verificação contínua da segurança, mesmo para acesso remoto a aplicações SaaS.

O SSE oferece suporte direto para diversos casos de uso de acesso remoto, incluindo:

- ZTNA Baseado em Cliente ( Client-Based ): Projetado para dispositivos corporativos gerenciados , requer a instalação de um módulo ZTA no endpoint . Este módulo intercepta e direciona o tráfego para a corretora SSE na nuvem, garantindo que a postura do dispositivo seja constantemente avaliada antes de conceder acesso a aplicações privadas.

- ZTNA Sem Cliente (Clientless): Utilizado para dispositivos não gerenciados (como parceiros ou convidados). O acesso é realizado via navegador (browser-based)ou dispositivo externo com função de gateway, onde o SSE atua como um reverse proxy após autenticação e autorização, eliminando a necessidade de clientes VPN tradicionais.

- ZTNA Baseado em VPN (VPN-Based): Permite a migração de concentradores VPN legados para a nuvem SSE, mantendo a conectividade VPN obrigatória, enquanto aplica cadeias de serviços de segurança e políticas de dados consistentes.

Em um modelo ZTNA, o acesso a aplicativos e recursos é fornecido com base na verificação rigorosa da postura do dispositivo e de outros fatores contextuais, independentemente da localização do usuário ou da conexão de rede.

Estratégias de Implementação ZTNA em Greenfield e Brownfield

A adoção do ZTNA através do SSE requer estratégias distintas, dependendo do estágio de maturidade da infraestrutura existente.

1. Implementação Greenfield (Início do Zero)

Em um ambiente Greenfield, a infraestrutura é construída do zero, permitindo uma implementação limpa e alinhada com o princípio Assume Breach. A estratégia se concentra em integrar a filosofia Zero Trust em todas as fases do ciclo de vida da rede.

A abordagem técnica envolve as seguintes etapas sequenciais:

- Definição de Objetivos: Formular uma visão clara de ZT, garantindo o alinhamento com os objetivos de negócio (e.g., fortalecimento da segurança e conformidade) e obtendo o apoio executivo necessário.

- Definição do Roteiro (Roadmap): Desenvolver um plano abrangente que delineie marcos, cronogramas e o orçamento essencial para tecnologia e treinamento.

- Desenvolvimento da Arquitetura e Projeto: Criar uma arquitetura de alto nível que incorpore nativamente a segmentação e a gestão de identidade (IAM). Isso inclui o desenho do layout de rede, estabelecendo zonas para diferentes tipos de ativos e dados, sendo a macrosegmentação a separação inicial e a microsegmentação (baseada em identidades ou SGTs) a base para o controle granular entre segmentos.

2. Implementação Brownfield (Infraestrutura Existente)

Em um ambiente Brownfield, o desafio reside na integração do ZTNA em sistemas legados e operacionais que foram concebidos sem os princípios de Zero Trust. A estratégia aqui é mais adaptável e faseada (phased and adaptable strategies) para mitigar interrupções operacionais.

A transição deve ser executada metodologicamente:

- Avaliação e Priorização: Realizar uma avaliação abrangente do ambiente de segurança atual, incluindo controles de acesso e privilégios de usuário.

- Foco no Risco Elevado: Identificar as áreas de maior risco, como aplicações críticas ou dados sensíveis, para iniciar a implementação do ZTNA.

- Transição Gradual e Adaptável: O objetivo é a transição gradual para o ZT, identificando vulnerabilidades e reforçando a segurança sem comprometer as operações em curso. Isso pode envolver o uso inicial de microsegmentação em modo de monitoramento antes da imposição total (enforcement) para entender os fluxos de tráfego e evitar a interrupção de sistemas legados.

Em ambos os cenários, a manutenção de políticas consistentes e a automação da resposta a ameaças (Automated Response and Orchestration) são importantes para o sucesso da arquitetura de acesso remoto. Ao assumir a premissa de violação presumida (Assume Breach), e ao aplicar continuamente políticas granulares por meio de SASE/SSE, as organizações podem evoluir de um modelo focado em perímetro para uma postura de segurança dinâmica e resiliente.

Concluindo…

A mudança para modelos de acesso baseados em SASE e SSE não é apenas uma tendência tecnológica, mas uma necessidade operacional ditada pela dispersão de usuários, dados e aplicações. A arquitetura de acesso remoto, embasada na tríade Explicit Verification, Least-Privilege Access e Assume Breach, e implementada através de estratégias de microsegmentação (base de ZTNA), garante que o acesso, seja ele em uma implantação Greenfield ou uma transição Brownfield, seja sempre autenticado, autorizado e continuamente monitorado. A capacidade de aplicar políticas de forma uniforme, independentemente da localização do usuário ou do recurso, transforma a arquitetura de acesso remoto em um componente habilitador de segurança, e não apenas um mecanismo de conectividade.

Referência

Zero Trust in Resilient Cloud and Network Architectures – Josh Halley, Dhrumil Prajapati, Ariel Leza, Vinay Saini – Cisco Press 2025

https://arubanetworking.hpe.com/techdocs/VSG/docs/125-remote-worker-design/esp-rw-000-design/